Robots.txt – co to jest?

Robots.txt to mały plik tekstowy umieszczany na serwerze internetowym, który służy do wydawania poleceń dla robotów odwiedzających stronę. Za jego pomocą właściciel witryny może wskazać, które zasoby mają być indeksowane przez wyszukiwarki, a do których dostęp powinien być ograniczony lub zablokowany.

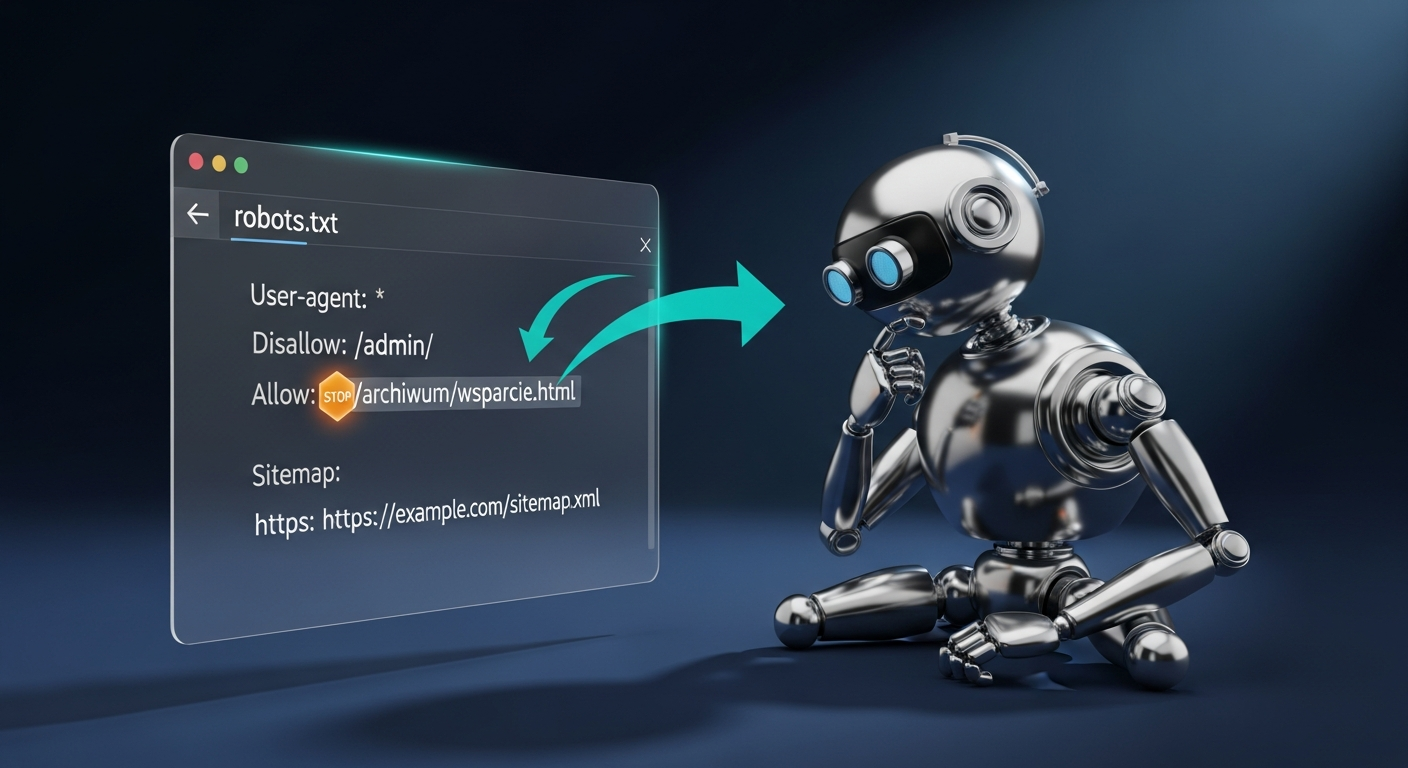

Jak działa plik robots.txt?

Roboty automatycznie pojawiające się na stronach, typu wyszukiwarki czy narzędzia analityczne, w pierwszej kolejności szukają pliku robots.txt w głównym katalogu witryny. Odczytują zawartość pliku i decydują, które części strony mogą pobierać i analizować. Jeżeli plik nie istnieje lub nie zawiera ograniczeń, boty uznają, że mają pełny dostęp do wszystkich treści pod adresem domeny.

Robots.txt opiera się na prostych dyrektywach – można precyzyjnie wskazać, dla których robotów mają obowiązywać określone zasady. Dzięki temu można ograniczyć indeksację np. zasobów tymczasowych, sekcji administracyjnej czy powtarzających się podstron, które nie wnoszą wartości z punktu widzenia wyszukiwarek.

Trzeba mieć świadomość, że polecenia robots.txt nie są dla wszystkich botów wiążące. Renomowane wyszukiwarki przestrzegają tych wskazań, jednak część robotów (np. spamujących lub szukających luk bezpieczeństwa) może je ignorować.

Elementy oraz składnia pliku robots.txt

Plik robots.txt składa się z prostych linii tekstowych. Każda linia wydaje polecenie dla wybranych robotów dotyczące dostępu do konkretnych ścieżek lub plików. Oto główne elementy pojawiające się w robots.txt:

- User-agent: oznacza określonego robota lub grupę robotów, dla których wypisujemy reguły (np. * oznacza wszystkie boty).

- Disallow: wskazuje katalogi albo pliki, dla których roboty mają zablokowany dostęp.

- Allow: stosuje się, gdy chcemy wyrazić zgodę na indeksowanie konkretnego zasobu, nawet gdy szersza ścieżka jest zablokowana.

- Sitemap: umożliwia podanie lokalizacji pliku mapy witryny, co ułatwia robotom odnalezienie wszystkich istotnych podstron.

- Host: opcjonalna dyrektywa stosowana zwłaszcza w przypadku wielu domen na jednym serwerze – podpowiada, która domena jest główna.

- #: znak hasztaga oznacza komentarz – linia nie jest przetwarzana przez roboty i służy tylko do opisu dla ludzi.

Poprawny plik robots.txt powinien być zapisany bez polskich znaków, najlepiej w kodowaniu UTF-8, i umieszczony bezpośrednio w katalogu głównym strony (np. https://twojawitryna.pl/robots.txt).

Typowe zastosowania pliku robots.txt

Plik robots.txt znajduje szerokie zastosowanie w zarządzaniu dostępem do treści na stronie. Oto najczęściej spotykane przypadki jego użycia:

- Blokowanie dostępu do stron technicznych – uniemożliwianie robotom indeksowania katalogów takich jak /admin/, /test/, /beta/ czy stron w trakcie budowy.

- Zarządzanie indeksacją powielonych treści – ograniczenie dostępu do podstron o zbliżonej zawartości, np. filtrów, sortowania produktów, wersji wydruku.

- Zabezpieczanie prywatnych danych – wykluczenie katalogów z danymi osobowymi, dokumentacją techniczną czy plikami roboczymi.

- Usprawnienie procesu indeksacji – poprzez wskazanie mapy strony roboty otrzymują wykaz wszystkich kluczowych podstron, co usprawnia ich odnajdowanie.

- Ograniczenie ruchu botów – niektóre rozbudowane serwisy blokują część robotów, by zapobiec obciążeniu infrastruktury i nadmiernej liczbie zapytań.

Wyobraźmy sobie polski sklep internetowy, który na czas sezonowej wyprzedaży udostępnia specjalną podstronę – można ją zablokować przed przedwczesnym zaindeksowaniem, dodając w robots.txt odpowiedni wpis. Innym przykładem są platformy edukacyjne kierujące roboty tylko do części materiałów publicznych, blokując resztę zasobów.

Przykłady poprawnej konfiguracji pliku robots.txt

Poniżej przedstawiono kilka realnych scenariuszy wykorzystania pliku robots.txt w polskich warunkach:

-

Przykład 1 – blokada katalogu administracyjnego:

User-agent: *

Disallow: /admin/ -

Przykład 2 – udostępnienie lokalizacji mapy witryny:

Sitemap: https://twojadomena.pl/sitemap.xml -

Przykład 3 – umożliwienie indeksowania jednej strony z zablokowanego katalogu:

User-agent: *

Disallow: /archiwum/

Allow: /archiwum/wsparcie.html -

Przykład 4 – ograniczenie ruchu botów jedynie do określonego katalogu:

User-agent: *

Disallow: /

Allow: /oferta-publiczna/ -

Przykład 5 – wskazanie głównej domeny przy wersjach na www i bez www:

Host: www.twojadomena.pl

Najczęściej popełniane błędy podczas konfiguracji robots.txt

Tworząc plik robots.txt, łatwo popełnić pomyłki skutkujące nieprawidłowym działaniem strony w wyszukiwarce. Do często spotykanych problemów należą:

- Całkowite zablokowanie dostępu do witryny przez mylne dodanie Disallow: /, co uniemożliwia wyszukiwarkom indeksację jakiejkolwiek treści.

- Brak aktualizacji pliku po zmianach w strukturze strony – nieaktualne ścieżki mogą być ignorowane przez roboty.

- Omyłkowe zezwolenie na indeksowanie wrażliwych danych lub sekcji, które nie powinny być publiczne.

- Pozostawienie zbyt ogólnych lub niedoprecyzowanych wpisów skutkujących niepełną kontrolą nad tym, co się indeksuje.

- Niezgodność składni (np. nieprawidłowe umieszczenie dyrektyw), powodująca, że roboty nie odczytują instrukcji poprawnie.

Przed wdrożeniem zmian do robots.txt warto przetestować plik za pomocą dostępnych narzędzi oraz zweryfikować efekty indeksacji w narzędziach webmastera.

Najważniejsze wskazówki dotyczące praktycznego stosowania robots.txt

- Każda zmiana pliku robots.txt jest natychmiast widoczna dla wszystkich botów – regularnie sprawdzaj zawartość i poprawność pliku.

- Nie używaj robots.txt do ukrywania wrażliwych informacji – lepiej zabezpieczyć je hasłem lub na poziomie serwera.

- W przypadku dynamicznych stron, generujących wiele URL-i (np. wyniki wyszukiwania, sortowania), stosuj wildcardy (*) oraz wykluczenia odpowiednich wzorców adresów.

- Przesyłaj do robotów aktualne lokalizacje mapy strony, by proces indeksacji przebiegał sprawnie i obejmował kluczowe podstrony.

- Jeśli prowadzisz wiele wersji językowych lub subdomen, z każdą wersją powinna być powiązana osobna konfiguracja robots.txt.

Testuj na bieżąco skuteczność pliku np. po wdrożeniu nowej sekcji, zmieniającej zawartość witryny lub reorganizacji nawigacji.

Najczęściej mylone pojęcia i zagadnienia powiązane

- Noindex vs Disallow – noindex informuje wyszukiwarkę, by nie indeksowała zawartości strony nawet jeśli do niej zajrzy, Disallow blokuje dostęp do adresu już na poziomie robotów; obie dyrektywy się uzupełniają.

- Sitemap.xml – plik zawierający spis wszystkich istotnych podstron witryny, ułatwiający robotom szybkie dotarcie do najważniejszych treści.

- .htaccess – plik konfiguracji serwera stosowany do przekierowań, uwierzytelniania oraz blokowania dostępu jeszcze przed załadowaniem strony.

- Meta robots – znacznik umieszczany w nagłówku HTML, umożliwiający precyzyjną kontrolę indeksacji poszczególnych podstron niezależnie od robots.txt.

Podsumowanie – jak zarządzać robots.txt dla skutecznego SEO?

Plik robots.txt to skuteczne narzędzie kontroli nad tym, co pojawia się w wynikach wyszukiwania dotyczących Twojej witryny. Pozwala świadomie kierować roboty do kluczowych treści, ograniczając jednocześnie dostęp do sekcji, które nie są wartościowe z perspektywy SEO. Dobrze przemyślana struktura oraz regularna aktualizacja pliku mogą uchronić przed utratą widoczności, indeksacją niepożądanych danych czy bałaganem w wyszukiwarce. Zarządzając robots.txt z głową, zwiększasz efektywność działań optymalizacyjnych i zapewniasz lepszą prezentację strony w internecie.