Googlebot – definicja i podstawy działania

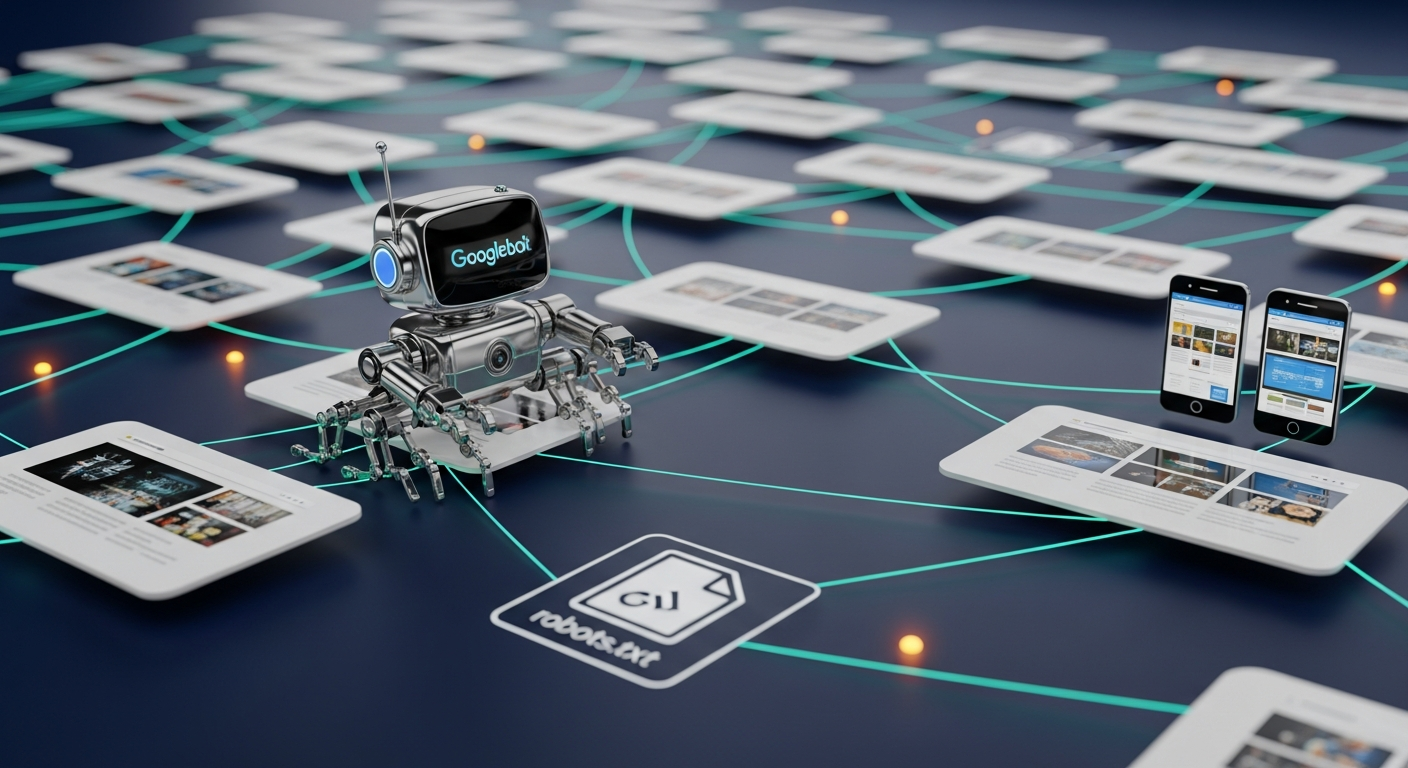

Googlebot to nazwa zaawansowanego programu komputerowego wykorzystywanego przez wyszukiwarkę Google do przeszukiwania i gromadzenia danych ze stron internetowych. Ten specjalistyczny bot porusza się po tysiącach witryn, analizując zawartość oraz struktury linków, aby umożliwić skuteczne indeksowanie nowych oraz zaktualizowanych treści w wynikach wyszukiwania Google.

W jaki sposób Googlebot odnajduje i analizuje strony internetowe?

Googlebot funkcjonuje w oparciu o ciągłe „przeczesywanie” sieci, proces znany jako crawling. Zaczyna pracę od przetwarzania listy wcześniej znanych adresów URL oraz map witryn (sitemaps) dostarczanych przez właścicieli stron. Podczas odwiedzin strony Googlebot analizuje jej zawartość, odczytuje wszystkie widoczne i ukryte linki, a następnie przechodzi do kolejnych podstron oraz witryn, na które prowadzą te odnośniki.

Kluczowym elementem działania Googlebota jest algorytm decydujący o kolejności oraz częstotliwości odwiedzin poszczególnych stron. Czynniki takie jak aktualność treści, popularność strony czy liczba odsyłających linków wpływają na to, jak często Googlebot wraca na daną witrynę. Proces ten pozwala na szybkie i skuteczne wyłapywanie nowości oraz utrzymanie aktualnej bazy witryn w indeksie Google.

Różne rodzaje Googlebotów

Warto wyróżnić dwa podstawowe typy robota Google:

- Googlebot Desktop – odtwarza zachowanie użytkownika korzystającego z komputera, przeglądając witrynę w wersji stacjonarnej,

- Googlebot Mobile – symuluje przeglądanie strony na urządzeniu mobilnym, analizując wersję przeznaczoną na smartfony i tablety.

Oba rodzaje pracują niezależnie i skupiają się na różnych aspektach funkcjonowania witryny, umożliwiając Google sprawdzenie, jak prezentuje się i działa strona na różnych typach urządzeń. Szczególnie w Polsce, gdzie wiele osób korzysta głównie z telefonów do przeglądania internetu, obecność Googlebota Mobile jest kluczowa dla skutecznego pozycjonowania.

Co się dzieje podczas wizyty Googlebota na stronie?

Podczas każdej wizyty, Googlebot wykonuje szereg czynności:

- Odczytuje kod źródłowy strony (HTML, CSS, JavaScript),

- Analizuje treści widoczne dla użytkownika,

- Wyszukuje wszystkie dostępne odnośniki oraz zewnętrzne pliki (np. grafiki),

- Sprawdza mapę witryny (jeśli jest dostępna),

- Respektuje pliki robots.txt, które mogą blokować dostęp do wybranych sekcji strony,

- Ocenia czas ładowania strony oraz jej dostępność na różnych urządzeniach.

Na podstawie zebranych danych Googlebot przesyła wyniki do systemu indeksowania. W ten sposób Google gromadzi coraz pełniejsze informacje na temat internetu, mogąc zwracać trafne wyniki na zapytania użytkowników. Jeśli strona jest bogata w treści i regularnie aktualizowana, robot będzie odwiedzał ją częściej. Braki w dostępności technicznej lub blokady mogą skutkować pominięciem lub rzadką indeksacją.

Jak Googlebot wpływa na pozycjonowanie stron internetowych?

Obecność Googlebota na stronie jest pierwszym krokiem do pojawienia się w wynikach wyszukiwarki i osiągnięcia wysokiej pozycji. Od jakości oraz kompletności danych, jakie zbiera ten robot, zależy jak witryna zostanie zindeksowana i oceniona przez algorytmy rankingowe. Istnieje kilka kluczowych aspektów w kontekście SEO, które warto znać:

- Dostępność dla robotów – błędnie skonfigurowany plik robots.txt może całkowicie zablokować Googlebota, co uniemożliwi indeksację serwisu,

- Szybkość strony – powolne ładowanie może zniechęcić robota do dalszego eksplorowania podstron,

- Responsywność i wersje mobilne – strony nieprzystosowane do urządzeń mobilnych mogą być gorzej oceniane przez Googlebota Mobile,

- Struktura i jakość treści – unikalne oraz wartościowe teksty zwiększają szanse na dokładną analizę oraz częstszą indeksację,

- Linkowanie wewnętrzne – odpowiednia liczba logicznych odnośników wewnątrz serwisu ułatwia Googlebotowi pełne zmapowanie strony.

Dla polskich witryn istotna jest też odpowiednia obsługa języka polskiego i lokalnych fraz kluczowych, co przekłada się na obecność w wynikach wyszukiwania podczas zapytań użytkowników z kraju.

Przykłady praktyczne – jak właściciele stron mogą zoptymalizować swoje witryny pod Googlebota?

Optymalizacja pod Googlebota oznacza działania, które zwiększają szanse na regularne odwiedziny i pełną indeksację serwisu. Oto kilka praktycznych wskazówek:

- Stworzenie mapy witryny (sitemap) – przesłanie aktualnej wersji do Google pozwala zasygnalizować robotowi wszystkie ważne adresy URL, nawet te trudno dostępne dla klasycznego crawla,

- Unikanie duplikacji treści – powtarzające się fragmenty mogą utrudniać interpretację zawartości i zmniejszać szanse na widoczność,

- Poprawna konfiguracja robots.txt – umożliwienie dostępu do niezbędnych zasobów oraz blokowanie tylko tych, które faktycznie nie muszą być indeksowane,

- Sprawdzanie serwisu w narzędziu Search Console – pozwala zobaczyć, jak Googlebot „widzi” stronę oraz wykryć potencjalne błędy indeksacji,

- Dbanie o krótkie i czytelne adresy URL – przejrzyste struktury ułatwiają analizę strony przez roboty,

- Dostosowanie serwisu do potrzeb użytkowników na różnych urządzeniach – responsywność oraz testy na smartfonach i tabletach zwiększają szanse na dobre wyniki w indeksie mobilnym.

Przykład z polskiego rynku: serwisy z ogłoszeniami lokalnymi, rozbudowane portale informacyjne oraz sklepy internetowe poprawiają swoją widoczność, dbając o przejrzystą nawigację, regularne aktualizacje oraz szybkie ładowanie stron zarówno na komputerach, jak i smartfonach.

Dlaczego Googlebot nie widzi wszystkich stron?

Często zdarza się, że pomimo obecności witryny w internecie, Googlebot nie odwiedza wszystkich jej podstron lub czyni to bardzo rzadko. Przyczyny mogą być różnorodne:

- Nieprawidłowe lub zbyt restrykcyjne ustawienia w robots.txt zabraniają robotowi wejścia na ważne sekcje,

- Błędy techniczne – np. uszkodzone linki, powolne ładowanie, błędy serwera,

- Trudna nawigacja lub zbyt głęboka struktura podstron bez wystarczającego linkowania wewnętrznego,

- Niski autorytet domeny – jeśli do witryny prowadzi mało jakościowych linków z innych stron, Googlebot może odwiedzać ją rzadziej,

- Brak świeżych treści – strony nieaktualizowane lub martwe są rzadziej analizowane przez Googlebota.

Prawidłowa optymalizacja techniczna oraz regularna dbałość o aktualność serwisu pozwala uniknąć tych problemów i zapewnić lepszą widoczność w wyszukiwarce.

Googlebot a inne roboty indeksujące

Nie tylko Google korzysta z własnych botów do eksplorowania internetu. Inne wyszukiwarki mają rozwinięte własne programy, jednak to Googlebot jest zdecydowanie najczęściej odwiedzającym polskie strony. Warto rozumieć podstawowe różnice pomiędzy botami różnych wyszukiwarek, ponieważ ich zachowanie może się nieco różnić. Googlebot znany jest ze stosowania bardzo zaawansowanych algorytmów rozumienia języka oraz dostosowywania się do różnych typów treści, co wyznacza standardy dla całej branży SEO w Polsce.

Najważniejsze wskazówki dla administratorów stron

- Regularnie monitoruj widoczność serwisu i błędy indeksacji za pomocą narzędzi analitycznych,

- Testuj stronę pod kątem dostępności dla botów – szczególnie w nowych projektach lub po dużych zmianach,

- Reaguj na komunikaty o problemach z indeksowaniem i błędach technicznych,

- Wprowadzaj aktualizacje i poprawki w kodzie zgodnie z zaleceniami dotyczącymi optymalizacji SEO,

- Dbaj o jakość linków prowadzących do serwisu – to jeden z czynników decydujących o częstotliwości odwiedzin przez Googlebota.

Podsumowanie – rola Googlebota w widoczności stron internetowych

Googlebot jest kluczowym elementem cyfrowego ekosystemu i odgrywa zasadniczą rolę w pozycjonowaniu oraz promocji witryn w sieci. Dzięki regularnym wizytom i analizie zawartości, umożliwia aktualizowanie indeksu Google oraz efektywne odpowiadanie na miliony zapytań użytkowników. Administracja stroną z uwzględnieniem wymagań Googlebota to niezbędny element skutecznej strategii SEO, pozwalający osiągać lepszą widoczność i przewagę na polskim rynku.