Blokowanie indeksowania – definicja i podstawowe założenia

Blokowanie indeksowania to zestaw technik, które uniemożliwiają robotom wyszukiwarek internetowych dodawanie określonych treści z danej witryny do bazy wyników wyszukiwania. Dzięki temu administratorzy mogą decydować, które podstrony pojawią się w rezultatach wyszukiwania, a które pozostaną ukryte przed powszechnym dostępem przez wyszukiwarki internetowe.

Dlaczego blokowanie indeksowania jest istotne?

Ograniczenie indeksowania dotyczy wielu sytuacji związanych z funkcjonowaniem stron internetowych. Zastosowanie tych metod pozwala na pełniejszą kontrolę nad prezentacją serwisu w wynikach wyszukiwania oraz ochronę treści poufnych, tymczasowych lub takich, które nie są przeznaczone dla szerokiego grona odbiorców. Blokowanie indeksowania chroni zarówno przed przypadkowym ujawnieniem ważnych danych, jak i przed niechcianym powielaniem treści w wyszukiwarkach, co mogłoby prowadzić do tzw. kanibalizacji pozycji czy obniżenia widoczności całej witryny.

Właściciele stron często korzystają z tej możliwości w przypadku podstron testowych, stref dla partnerów biznesowych, plików konfiguracyjnych czy archiwalnych dokumentów. Dotyczy to zarówno prostych witryn firmowych, jak i rozbudowanych platform e-commerce czy miejsc z treściami abonamentowymi.

Sposoby zablokowania indeksowania treści strony

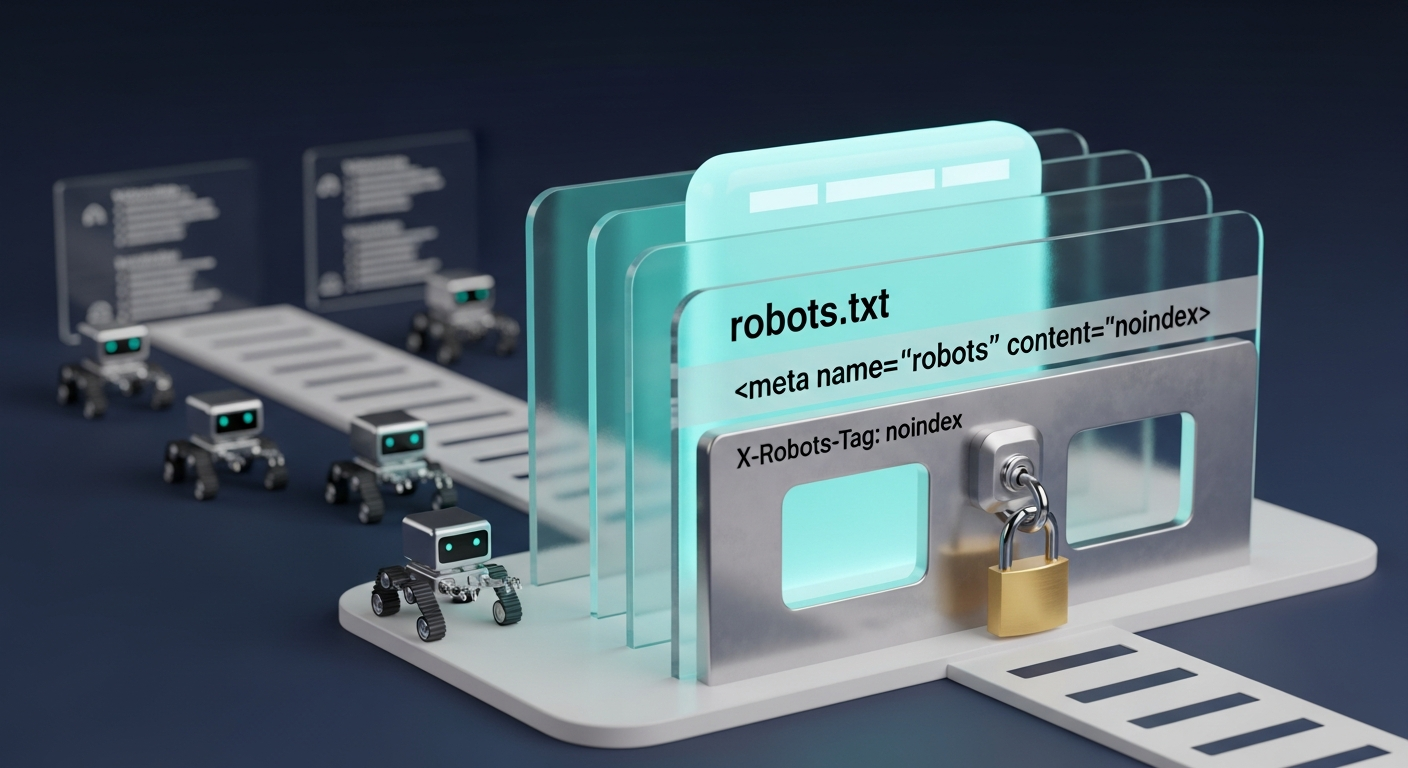

Istnieje kilka technik pozwalających skutecznie ograniczyć indeksowanie wybranych części witryny. Każda z nich sprawdza się w innych okolicznościach i dedykowana jest dla odmiennych typów treści.

- robots.txt – specjalny plik tekstowy umieszczony w głównym katalogu strony. Dzięki niemu można wykluczyć całe katalogi, wybrane pliki lub konkretne podstrony. Przykładowa linia w tym pliku może wyglądać tak:

- Disallow: /admin/ – blokada indeksowania panelu administracyjnego

- Disallow: /testowa-podstrona.html – wykluczenie pojedynczej podstrony

- Meta tag noindex – umieszczany w sekcji <head> każdej podstrony, której nie chcemy udostępniać w wyszukiwarkach. Przykład użycia:

<meta name="robots" content="noindex"> - Nagłówek X-Robots-Tag – stosowany na poziomie odpowiedzi serwera HTTP. Pozwala wykluczać z indeksacji nie tylko strony HTML, ale także dokumenty PDF, pliki graficzne i inne zasoby. Przykład:

X-Robots-Tag: noindex - Blokowanie dostępem (uwierzytelnienie) – często stosowane w przypadku sekcji chronionych hasłem. Bez możliwości zalogowania się treść nie jest widoczna, również dla robotów.

- Usunięcie treści z mapy strony – eliminacja adresów z pliku sitemap.xml, przez co robotom trudniej trafić na ukryte materiały.

Popularne zastosowania blokowania indeksowania w praktyce

Technika ta znajduje zastosowanie w wielu branżach i rodzajach serwisów internetowych. Oto wybrane przykłady z polskiego rynku:

- Sklepy internetowe – wykluczanie stron z regulaminem, polityką prywatności, wewnętrznych narzędzi do zarządzania zamówieniami lub stron testowych dotyczących nowych rozwiązań e-commerce.

- Strony rekrutacyjne – blokowanie ogłoszeń, które straciły ważność lub zostały zastąpione nowymi ofertami, aby nie wprowadzać kandydatów w błąd oraz chronić proces rekrutacji.

- Portale informacyjne – ochrona materiałów archiwalnych, wersji roboczych artykułów, paneli edytorskich oraz baz danych służących do przygotowania publikacji.

- Systemy zarządzania dokumentami – zabezpieczanie dokumentacji technicznej przed przypadkowym upublicznieniem oraz wykluczanie dokumentów udostępnionych tylko wybranym pracownikom lub kontrahentom.

- Lokalne firmy usługowe – niewyświetlanie podstron dedykowanych promocjom tymczasowym lub sezonowym, które nie są już aktualne, w celu uniknięcia dezorientacji klientów.

Typowe błędy i wskazówki dotyczące blokowania indeksowania

Prawidłowe wdrożenie blokowania wymaga znajomości mechanizmów działania robotów wyszukiwarek oraz testowania efektów w praktyce. Poniżej zestaw praktycznych porad i błędów, których należy unikać:

- Blokowanie całego katalogu za pomocą robots.txt zamiast pojedynczych stron – zbyt szerokie restrykcje mogą ukryć istotne treści.

- Użycie robots.txt zamiast noindex – jeśli adres jest już zaindeksowany, robots.txt nie usunie go z wyników wyszukiwania, lecz tylko ograniczy dostęp do treści dla robotów.

- Brak regularnej kontroli pliku robots.txt – nawet drobna literówka może zablokować całą witrynę przed pojawianiem się w wynikach wyszukiwania.

- Kombinowanie wielu metod blokowania bez koordynacji – nieprzemyślane nakładanie różnych technik może prowadzić do trudnych w wykryciu problemów z widocznością strony.

- Niewyłączenie starego contentu po dużych aktualizacjach – utrzymywanie niechcianych treści prowadzi do kanibalizacji słów kluczowych.

Ciekawostki i powiązane zagadnienia

Blokowanie indeksowania to tylko jedna z wielu technik zarządzania widocznością treści w internecie. W bliskim powiązaniu znajdują się także:

- Kanonikalizacja adresów URL – zapobiega powstawaniu duplikatów i wskazuje robotom, którą wersję strony pokazywać użytkownikom.

- Blokada IP – ograniczenie dostępu do strony z wybranych adresów IP, przydatne przy ochronie paneli administratora.

- Kategoryzacja uprawnień użytkowników – umożliwia dzielenie treści na jawne i tylko dla zalogowanych.

- Przekierowania 301/302 – pozwalają użytkownikom i robotom trafić na aktualne wersje treści, jednocześnie wykluczając stare adresy z indeksów.

Weryfikacja skuteczności blokowania indeksowania

Bardzo ważne jest regularne monitorowanie efektów stosowanych blokad. Narzędzia do analizy witryn oraz raporty z wyszukiwarek pokazują, które adresy nadal znajdują się w wynikach. Typowe techniki sprawdzania:

- Zapytania site:adres-strony w popularnych wyszukiwarkach, by zobaczyć, które podstrony są indeksowane.

- Automatyczne crawlery – sprawdzają obecność wybranych tagów i statusów nagłówków HTTP.

- Ręczna analiza źródła strony pod kątem obecności meta tagów.

Wdrożenie blokowania indeksowania nie jest decyzją jednorazową – sytuacja rozwija się wraz z rozwojem witryny, więc wszystkie działania dobrze jest rewidować po każdej większej zmianie struktury serwisu.

Podsumowanie – skuteczne zarządzanie indeksem a jakość treści

Odpowiednie ograniczanie indeksowania stron zwiększa bezpieczeństwo witryny, poprawia higienę wyników wyszukiwania oraz ułatwia prowadzenie efektywnych działań SEO. Warto dokładnie planować, które podstrony mają być widoczne dla wyszukiwarek, uwzględniając aktualność treści, ich wartość dla użytkownika oraz strategię rozwoju serwisu. Regularne monitorowanie skutków wprowadzonych zmian pozwala unikać przypadkowego odcięcia kluczowych treści od potencjalnych odbiorców.